Nga Gazeta ‘Si’– Sa e lehtë do të ishte që një person keqdashës, pa njohuri shkencore, por me qëllime të rrezikshme, të krijojë dhe të përhapë një patogjen të rrezikshëm?

Pragu po ulet vazhdimisht.

Përparimet në sekuencimin gjenetik kanë bërë që “recetat” për agjentë biologjikë të jenë gjithnjë e më të aksesueshme; mjetet e modifikimit gjenetik si CRISPR mund, teorikisht, të kthejnë mikroorganizma të padëmshëm në diçka vdekjeprurëse; ndërsa pajisjet për ndërtimin dhe rritjen e proteinave apo viruseve të rrezikshme mund të blihen online për disa qindra dollarë.

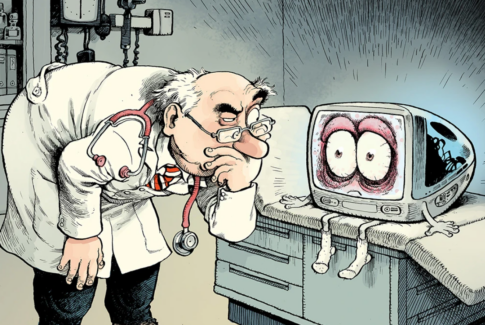

Tani në këtë ekuacion kanë hyrë edhe modelet e mëdha gjuhësore (LLM).

Të trajnuara me një sasi të madhe njohurish shkencore, përfshirë informacion të specializuar në virologji dhe bakteriologji, modelet e inteligjencës artificiale mund t’i kthejnë përdoruesit fillestarë në “ekspertë” brenda natës- një shqetësim që specialistët e biosigurisë e shohin gjithnjë e më seriozisht.

Vitin e kaluar, kompani si OpenAI, Anthropic dhe Google forcuan masat e sigurisë, pasi nuk mund të përjashtonin më mundësinë që modelet e tyre të ndihmonin persona pa formim shkencor të zhvillonin armë biologjike.

Kjo ngre pyetjen nëse bota po i afrohet një epoke të frikshme bioterrorizmi të ndihmuar nga AI dhe çfarë mund të bëhet për ta parandaluar.

Një person që synon bioterrorizmin mund të marrë informacion të dobishëm nga AI.

Në dhjetor 2025, instituti britanik AI Security Institute raportoi se modelet kryesore mund të gjenerojnë protokolle shkencore për sintetizimin e viruseve dhe baktereve nga fragmente gjenetike.

Po atë muaj, studiues nga RAND Corporation treguan se modele të disponueshme komercialisht mund të ndihmojnë në fazat më të vështira të ndërtimit të ARN-së së poliovirusit.

Megjithatë, siç thekson Michael Imperiale, krijimi i një agjenti vdekjeprurës nuk është aq i thjeshtë sa futja e një molekule ADN-je apo ARN-je në qeliza.

Sfida kryesore është kalimi nga teoria në praktikë: të kuptosh pse një eksperiment dështon dhe si të korrigjohet- aftësi që nuk mësohen vetëm nga librat. Megjithatë, LLM-të po ndihmojnë edhe në këtë drejtim.

Një shembull është testi “Virology Capabilities Test”, zhvilluar nga SecureBio. Kur ekspertët e fushës e provuan, rezultati mesatar ishte vetëm 22%. Ndërsa fillestarët që përdorën LLM arritën 28%, sipas një studimi të Scale AI. Modelet që e kryen testin pa ndihmë njerëzore arritën deri në 61%, nivel i krahasueshëm me ekipet më të mira të virologëve.

Këto rezultate kanë nxitur rritjen e masave të sigurisë, por studime të tjera tregojnë se AI ende nuk është një “asistent laboratori” i besueshëm.

Një studim i Active Site zbuloi se përdorimi i AI nuk përmirëson ndjeshëm performancën e fillestarëve në laborator. Nga 153 pjesëmarrës, vetëm katër që përdorën AI arritën të përfundonin detyrat kryesore-më pak se grupi që përdori vetëm internetin.

Modelet shpesh jepnin përgjigje që dukeshin të sakta, por ishin të gabuara.

Sipas studiuesit Joe Torres, kjo tregon se rreziku nga persona pa përvojë mund të jetë më i kufizuar nga sa mendohet. Por për ekspertët, situata është ndryshe. Cassidy Nelson thekson se AI mund të rrisë aftësitë e tyre në disa aspekte, edhe pse në të tjera mund të krijojë probleme. Modelet e Anthropic, për shembull, ndihmojnë në krijimin e protokolleve më të shpejta, por shpesh përmbajnë gabime kritike.

Një problem tjetër është se modelet mund të jenë tepër “dakordësuese” dhe të mbështesin ide të gabuara. Studiues si Sonia Ben Ouagrham-Gormley theksojnë një paradoks: nëse dikush ka nevojë për ndihmën e modelit, ai nuk është në gjendje të kuptojë kur këshillat janë të gabuara.

Megjithatë, fakti që edhe disa fillestarë arritën të krijojnë një virus në kushte laboratorike nuk duhet nënvlerësuar, paralajmëron Luca Righetti. Për më tepër, përparimi teknologjik vazhdon.

Mjete të reja biologjike mund të modifikojnë patogjenët ekzistues për t’i bërë më të rrezikshëm, më të transmetueshëm dhe më rezistentë.

Ndërkohë, ka ende shumë paqartësi. Nuk dihet nëse AI është më e rrezikshme në duart e ekspertëve apo përdoruesve të avancuar të saj.

Asnjë studim publik nuk ka treguar ende nëse AI mund të ndihmojë realisht në krijimin e patogjenëve të rrezikshëm në kushte reale, apo në prodhimin e tyre në shkallë të madhe.

Plotësimi i këtyre boshllëqeve kërkon përfshirje të qeverive dhe bashkëpunim ndërkombëtar. Kjo sepse eksperimente të tilla mund të bien ndesh me Biological Weapons Convention. Për shembull, studiues të Microsoft krijuan mijëra sekuenca ADN-je të modifikuara për të treguar dobësitë e sistemeve të kontrollit, por nuk i sintetizuan ato për arsye ligjore dhe etike.

Përballë këtyre rreziqeve, disa ekspertë sugjerojnë ngadalësimin e zhvillimit të modeleve të reja. Anthropic, për shembull, ka kufizuar aksesin në një nga modelet e saj më të avancuara për sigurinë kibernetike. Një qasje e ngjashme mund të jetë e nevojshme edhe për modelet me kapacitete biologjike.

Me pasoja kaq të mëdha në lojë, një qasje më e kujdesshme dhe më e ngadaltë mund të jetë çelësi për të shmangur rreziqe serioze në të ardhmen./ The Economist

Copyright © Gazeta “Si”

Të gjitha të drejtat e këtij materiali janë pronë ekskluzive dhe e patjetërsueshme e Gazetës “Si”, sipas Ligjit Nr.35/2016 “Për të drejtat e autorit dhe të drejtat e tjera të lidhura me to”. Ndalohet kategorikisht kopjimi, publikimi, shpërndarja, tjetërsimi etj, pa autorizimin e Gazetës “Si”, në të kundërt çdo shkelës do mbajë përgjegjësi sipas nenit 179 të Ligjit 35/2016.

.png)

Lini një Përgjigje